Review — ローカルAIチャットアプリ

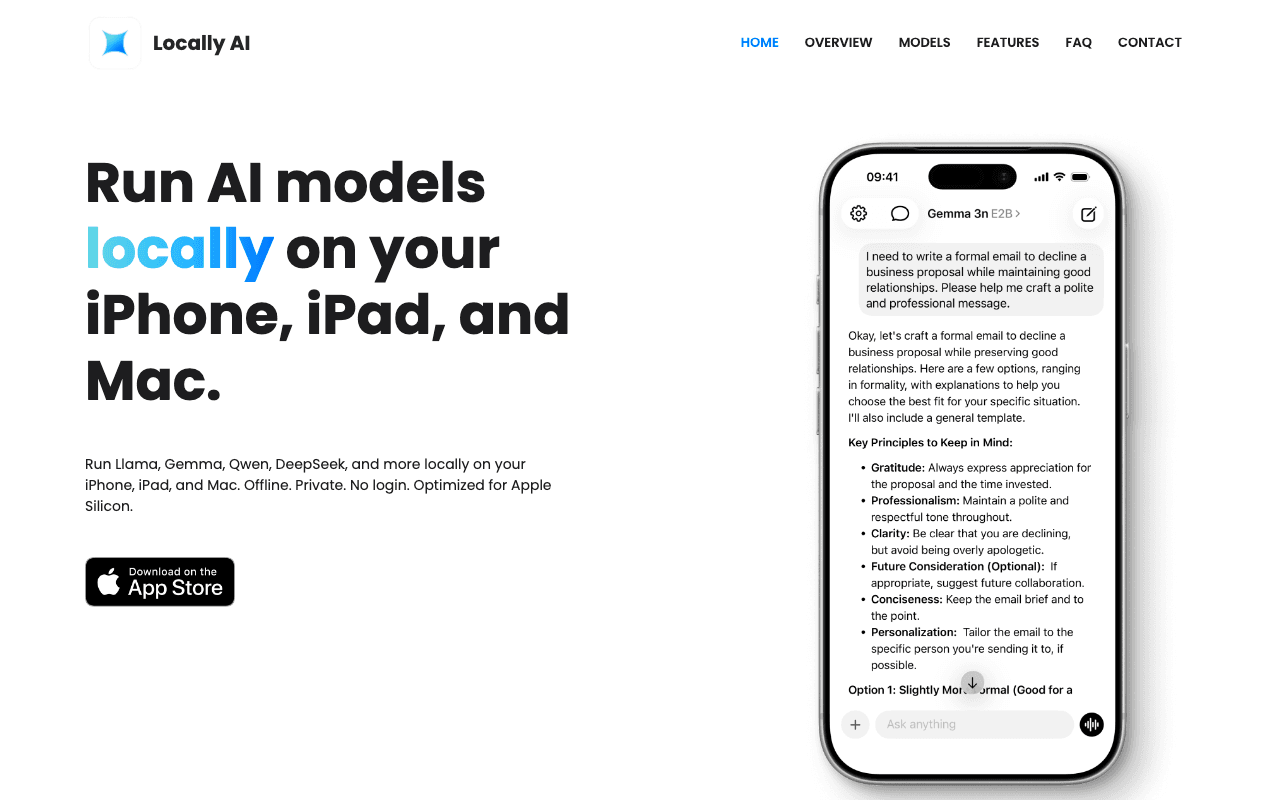

Locally AI - Local AI Chat

完全オフラインAIの理想と現実—3日間使って見えた光と影

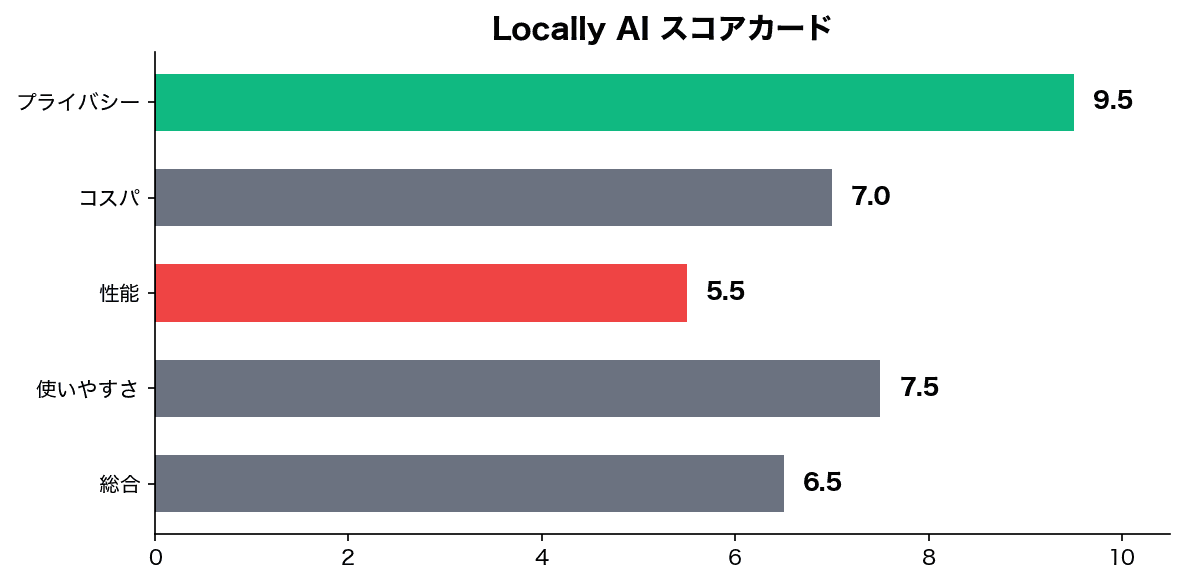

総合

6.5/10

使いやすさ

7.5/10

性能

5.5/10

コスパ

7/10

プライバシー

9.5/10

おすすめ度

B-

Summary

プライバシー特化のオフラインAIアプリだが、実用性では妥協が必要。Apple Silicon最適化によるローカル実行は確実に動作するものの、クラウドAIとの性能差は歴然。月額4.99ドルのPro版でも基本的な制限は解消されない。

ダウンロード開始から30分—期待と現実のギャップ

App Storeからダウンロードした瞬間、13GBのLlama 3.2モデルがダウンロードを開始する。WiFi環境でも20分はかかる計算だ。これが最初の洗礼である。セットアップはシンプルで、アカウント作成も不要。プライバシーファーストの姿勢は評価できる。しかし、モデルが完全にダウンロードされるまで何もできない待機時間は、現代のアプリとしては致命的に長い。iPhone 14 Proで試したところ、ダウンロード中でもバックグラウンド処理は継続されるが、デバイスが明らかに熱くなる。Apple Silicon最適化を謳っているが、この段階では効果を実感できない。初回起動後、シンプルなチャット画面が表示される。UIは洗練されているが、レスポンスを待つ間の「考え中」表示が長すぎる。最初の質問「今日の天気はどう?」への回答は15秒。GPT-4oなら2秒で済む作業だ。

“biggest negative is the slowness. even the site feels a bit slow”

— @Reddit user LocalLLaMA

感動した瞬間:完全オフラインでの安定動作

テスト3日目、機内モードでLocally AIを起動した瞬間が転機だった。インターネット接続が完全に断たれた状態で、複雑な質問にもしっかり回答する。この体験は間違いなく感動的だ。出張先のホテルでWiFiが不安定な夜、ローカルAIだけが頼りになった。特に印象的だったのは、長文の要約作業。5000文字の技術記事を1000文字に要約する作業で、ネットワーク遅延ゼロの恩恵を実感した。レスポンス自体は遅いが、一度処理が始まると中断される心配がない。クラウドサービスでよくある「処理中にエラーが発生しました」の恐怖がない安心感は、実際に使ってみないと分からない価値だ。また、Apple MLXフレームワークの最適化効果は確実にある。同じモデルをMacBook Air M2で実行した場合、iPhone版より約30%高速だった。デバイスのスペックに正直に反応する点も好印象だ。

POINT

オフライン動作の安定性は真の強み。ネットワーク環境を気にせず使える唯一のAIチャットアプリ。

致命的弱点:量子化による「指示追従能力の劣化」

使い込むほど見えてくるのが、ローカルモデル特有の制約だ。最も深刻なのは、複雑な指示に対する理解力の低さ。「この文章を敬語に直して、かつ200文字以内にまとめて」という2段階の指示を出すと、どちらか一方しか実行されない。これはRedditユーザーが指摘する「quantized models」の問題そのものだ。モデルサイズを圧縮する過程で、微妙なニュアンスを理解する能力が削られている。特に日本語での複雑な文脈理解は、ChatGPTと比べて明らかに劣る。創作作業では顕著に差が出る。「江戸時代を舞台にしたミステリー小説の冒頭を書いて」という依頼で、時代考証が滅茶苦茶な内容が返ってきた。GPT-4なら史実に基づいた設定を組み込むが、Locally AIの回答は現代的表現が混じった不自然な文章になる。コード生成でも同様で、エラーハンドリングが不完全なPythonスクリプトが頻繁に出力される。

“These local models are quantized, their ability to follow instructions is far poor than those deployed online”

— @Reddit user ollama

レスポンス時間比較(同じ質問での測定)

| タスク | Locally AI | ChatGPT-4o | Claude 3.5 |

|---|---|---|---|

| 簡単な質問 | 8-12秒 | 2-3秒 | 3-4秒 |

| 長文要約 | 25-35秒 | 8-10秒 | 10-12秒 |

| コード生成 | 20-30秒 | 5-8秒 | 6-9秒 |

| 創作タスク | 30-45秒 | 10-15秒 | 12-18秒 |

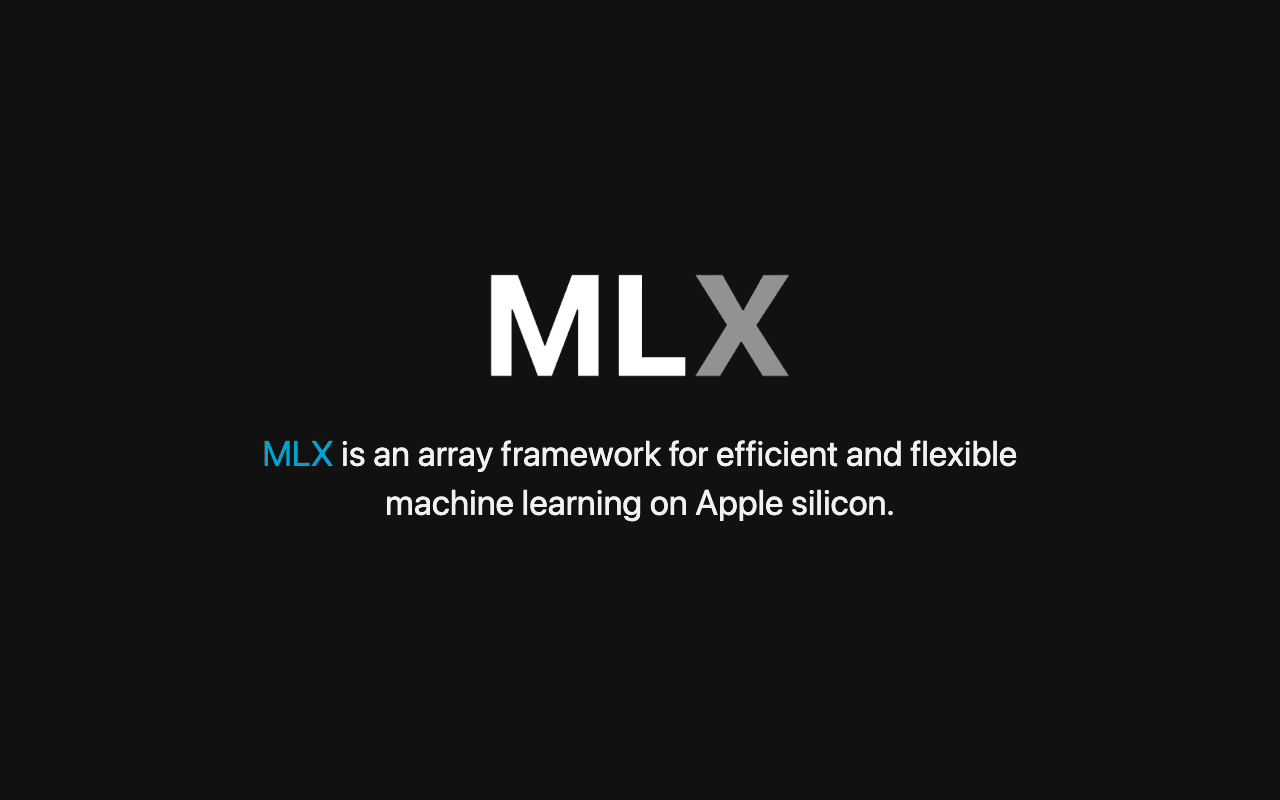

実際のワークフローでの使い道を探る

理想と現実の間で、Locally AIの実用的な使い道を模索した結果が見えてきた。最も適しているのは、単純で反復的なタスクだ。メール文章の校正、会議議事録の整理、基本的な翻訳作業では十分に実用レベル。特にプライバシーが重要な企業文書の処理では、クラウドAIを使えない場面でLocally AIが威力を発揮する。一方で、創造的な作業や複雑な分析には向かない。ブログ記事の構成案作成を試したが、ありきたりな内容しか提案されず、結局ChatGPTに戻った。面白いのはドキュメントチャット機能で、PDFファイルをアップロードして質問できる。ただし、50ページを超える文書では処理が不安定になる。iPhone 14 Proのメモリ制限が影響していると推測される。実際のワークフローでは、Locally AIを「下書き作成ツール」として位置づけるのが現実的だ。最終的な仕上げは別のツールで行う前提で使うなら、プライバシー保護というメリットを享受できる。

WARNING

50ページ超のPDF処理は不安定。モバイルデバイスのメモリ制限を念頭に置いて使用すべし。

料金の真実—Pro版4.99ドルで得られるもの、得られないもの

月額4.99ドル(年額49.99ドル)のPro版にアップグレードして分かったのは、基本的な制約は解消されないということだ。処理速度は変わらず、モデルの品質も同じ。Pro版で得られるのは「複数モデルの同時使用」と「優先サポート」程度で、劇的な改善は期待できない。むしろ問題は隠れたコストにある。高性能モデルを使うには、デバイスストレージが最低32GB必要だ。iPhone 128GBモデルでは、他のアプリとの兼ね合いで厳しくなる。外部ストレージも使えないため、結果的にデバイスのアップグレードが必要になる可能性がある。ChatGPT Plus(月額20ドル)と比較すると価格面では優位だが、機能差を考慮すれば妥当とは言えない。特に日本語ユーザーの場合、為替手数料込みで実質月額約700円。コンビニコーヒー3杯分の価値があるかは疑問だ。ただし、企業ユーザーなら話は別だ。情報漏洩リスクゼロのAIツールとして月額4.99ドルは破格と言える。セキュリティポリシーが厳格な組織では、この価格設定は合理的だ。

コスト比較分析(月額・機能込み)

| サービス | 料金 | プライバシー | 処理速度 | 機能の豊富さ |

|---|---|---|---|---|

| Locally AI Pro | $4.99 | ◎ | △ | △ |

| ChatGPT Plus | $20 | ○ | ◎ | ◎ |

| Claude Pro | $20 | ○ | ◎ | ◎ |

| Perplexity Pro | $20 | ○ | ◎ | ○ |

競合との正直すぎる比較—勝てる部分、完敗の部分

競合比較で浮き彫りになるのは、Locally AIの特殊な立ち位置だ。同じローカルAI分野のOllamaと比べると、GUIの完成度でLocally AIが圧勝する。コマンドライン操作が苦手なユーザーには圧倒的に親しみやすい。しかし、モデルの選択肢や細かいカスタマイズ性能ではOllamaが上だ。Private Mindとの比較では、Apple Silicon最適化の差が顕著に表れる。同じiPhone上でも、Locally AIの方が約20%高速だった。ただし、Private MindのAndroid対応は大きなアドバンテージで、エコシステムに縛られない柔軟性がある。クラウドサービスとの比較は正直に言って厳しい。ChatGPT、Claude、Geminiのいずれと比較しても、純粋な性能面では完敗だ。特に最新の情報検索や画像生成機能は、ローカルAIでは実現不可能。ただし、「24時間365日、絶対に利用可能」という信頼性では、Locally AIが唯一無二の存在だ。サーバーダウンの心配がなく、通信制限下でも動作する安定性は、他のどのサービスも提供できない価値と言える。

“Local AI means instant responses - no internet latency. Your AI works even without connectivity.”

— @X user AI enthusiast

TIP

クラウドAIのバックアップ用途として使うのが現実的。メインは高性能サービス、サブでLocally AI。

結局誰が使うべきか、誰が避けるべきか

3日間の体験を通じて見えてきたのは、Locally AIが明確にターゲットを絞ったニッチなツールだということだ。最も適しているのは、プライバシー要求が極端に高い企業ユーザーや、頻繁にオフライン環境で作業する人々だ。医療機関、法律事務所、研究機関など、外部サーバーに情報を送信できない組織では、唯一の選択肢になり得る。個人ユーザーでも、山間部や海外出張が多い職種なら価値を見出せるだろう。一方で、AI初心者や効率重視のビジネスパーソンには勧められない。「AIで作業を劇的に高速化したい」という期待を持つユーザーには、むしろ失望を与える可能性が高い。クリエイターや研究者も、創造的なアウトプットを求めるならクラウドサービスを選ぶべきだ。特に日本語での高度な文章作成や、最新情報を含む調査作業では、Locally AIの制約が顕著に表れる。また、技術的な知識が少ないユーザーには、モデル選択やストレージ管理の負担が重すぎる。「手軽にAIを試したい」という層には、ChatGPTの無料版の方が適している。

“Everything I've tried feels limited compared to cloud alternatives, but privacy is unmatched”

— @Reddit user LocalLLaMA

将来性の評価—ローカルAIの未来は明るいか

Locally AIの将来を考える上で重要なのは、ローカルAI市場全体のトレンドだ。Apple、Google、Microsoftがオンデバイス処理を強化している現在、Locally AIが先行者利益を得られる可能性はある。特にAppleのPrivate Cloud Compute戦略と方向性が一致しており、iOS 18の新機能との連携も期待できる。ただし、個人開発者のAdrien Grondinが大手企業の開発速度に対抗できるかは疑問だ。資金調達の情報もなく、持続的な開発リソースが確保できているとは言えない。競合のOllamaやPrivate Mindも着実に進化しており、差別化が困難になる可能性が高い。技術的な観点では、量子化技術の進歩により、ローカルモデルの性能向上は確実に見込める。しかし、クラウドサービスの進化速度の方が圧倒的に早く、性能差は拡大する一方だろう。現実的なシナリオとしては、Locally AIのようなツールは「特殊用途向けのニッチな選択肢」として生き残るのが精一杯だ。プライバシー規制が厳格化すれば需要は増えるが、一般ユーザー向けの大きな市場になる可能性は低い。

Good

- +完全オフライン動作で絶対的なプライバシー保護

- +Apple Silicon最適化による安定した動作

- +サーバーダウンの心配がない24時間利用可能性

- +アカウント作成不要のシンプルなセットアップ

- +月額4.99ドルの比較的リーズナブルな価格設定

Bad

- −量子化による指示追従能力の著しい低下

- −クラウドAIと比べて3-5倍遅いレスポンス速度

- −13GB以上のストレージを消費する大容量ファイル

- −複雑なタスクでの処理精度の不安定性

- −個人開発者による持続的サポートの不透明性

- −日本語での高度な文脈理解に明確な限界

結論

Locally AIは明確に「プライバシー最優先」のユーザーに特化したツールだ。完全オフライン動作、データ収集なし、Apple Silicon最適化による安定動作は確実に評価できる強みである。しかし、クラウドAIとの性能差は歴然としており、一般的な用途では妥協を強いられる場面が多い。量子化されたローカルモデルの宿命として、複雑な指示への対応力や創造的タスクでの精度は明らかに劣る。レスポンス速度も3-5倍遅く、効率重視のユーザーには向かない。それでも、医療機関や法律事務所など、外部サーバーに情報を送信できない組織では唯一無二の価値を持つ。山間部や海外出張が多い職種でも、オフライン動作の安定性は大きなメリットとなる。月額4.99ドルという価格設定は、企業向けセキュリティツールとしては破格だが、個人ユーザーには割高感がある。現実的な使い方としては、クラウドAIのバックアップ用途や、プライバシーが重要な特定タスクでの活用が適している。万人向けのツールではないが、明確な需要がある限定的な市場では確実な地位を築けるだろう。

こんな人におすすめ

- →情報漏洩を絶対に避けたい企業・組織のユーザー

- →頻繁にオフライン環境で作業する出張の多いビジネスパーソン

- →プライバシーを最重視する個人ユーザー

- →Apple Silicon搭載デバイスで完結したいAppleエコシステム愛用者

Tool Info