Review — 自律型AIエージェント

OpenClaw

中国で1000人が行列、各国政府が警戒——数週間使い込んで見えた、バズの裏側にある本当の実力

総合

7.5/10

使いやすさ

5.5/10

性能

8/10

コスパ

8.5/10

プライバシー

6/10

おすすめ度

B+

Summary

OpenClawは2026年初頭に最もバイラルしたAIツールだが、その熱狂には冷静な検証が必要だ。オープンソースで無料、あらゆるLLMと連携できる万能エージェントという理想は確かに魅力的だが、セットアップの複雑さ、APIコストの不透明さ、セキュリティリスクという現実がある。中国政府が政府機関での使用を制限した事実は、このツールのポテンシャルと危うさの両面を象徴している。技術者なら一度は触るべきだが、万人向けではない。

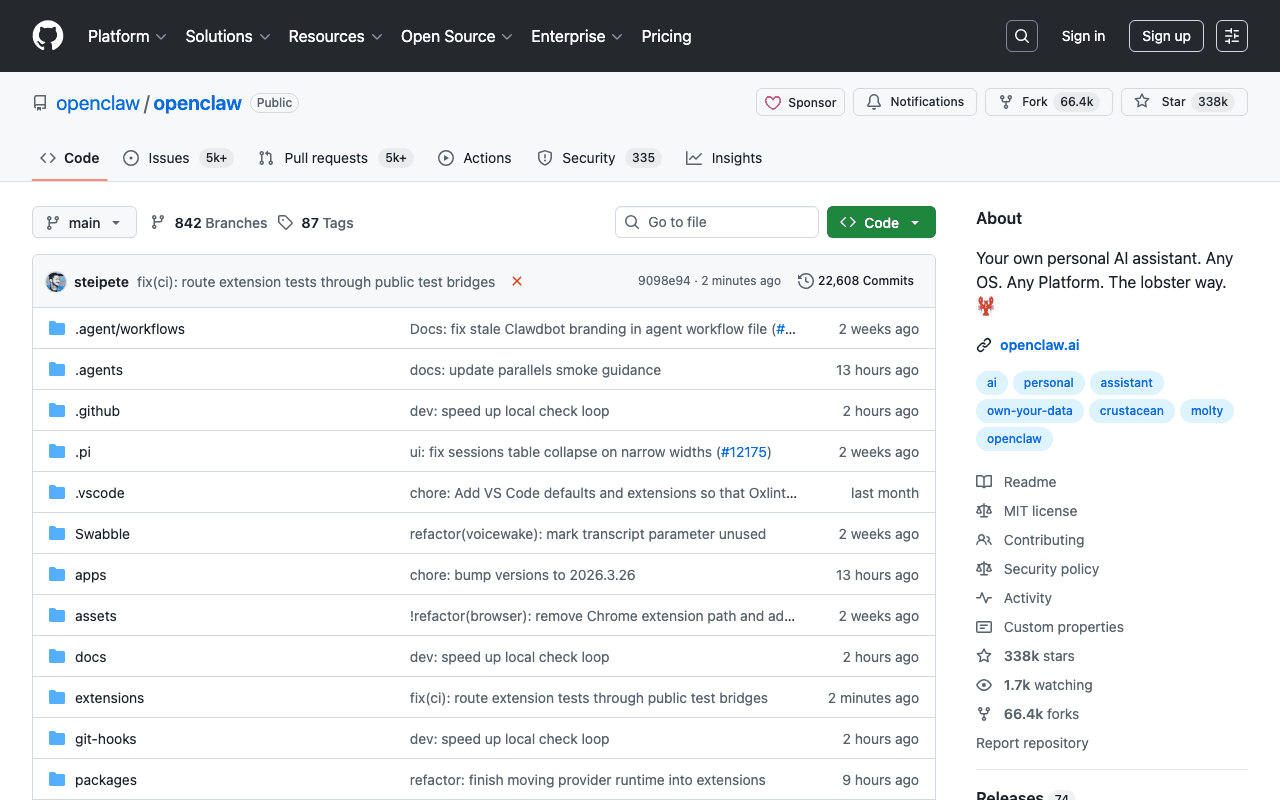

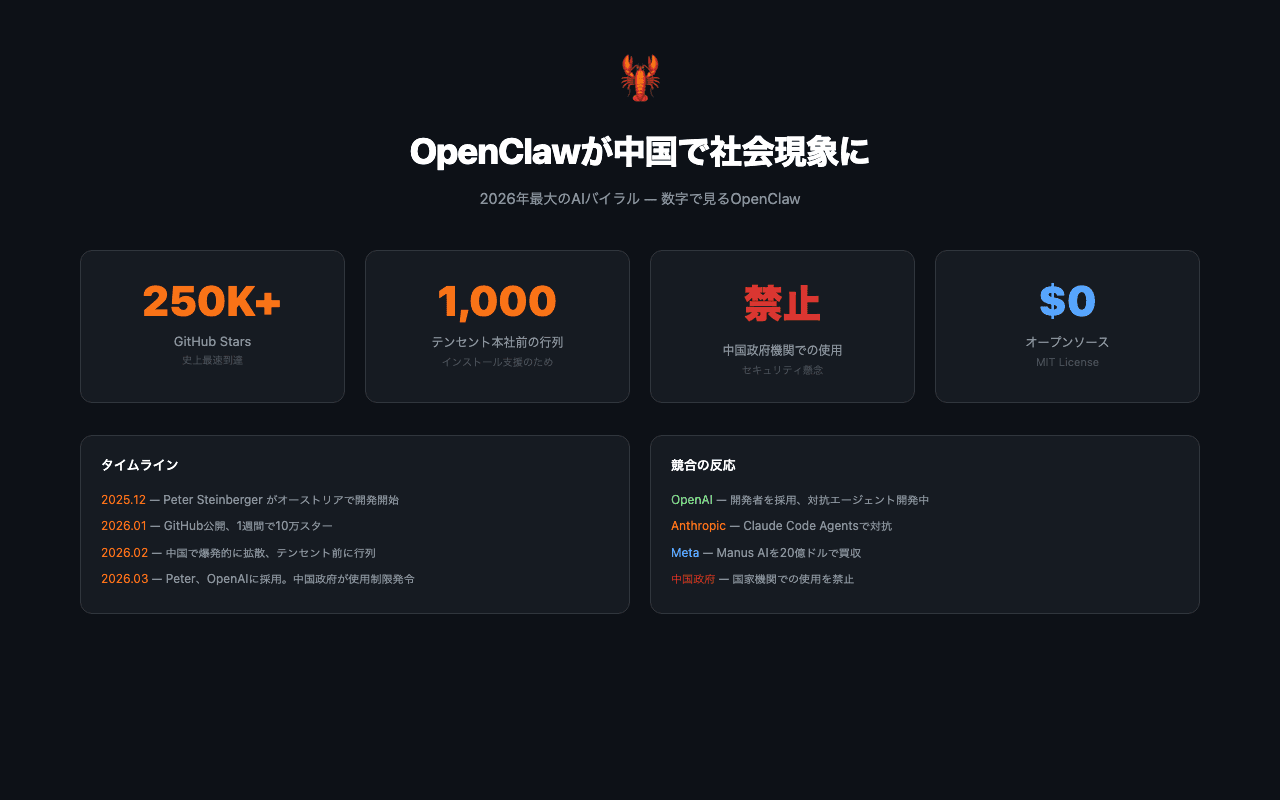

なぜ世界中が熱狂したのか:GitHub史上最速25万スターの衝撃

2026年の年明けから、テック業界を一つのプロジェクトが席巻した。OpenClaw——オーストリア人開発者Peter Steinbergerが個人プロジェクトとして始めた自律型AIエージェントが、GitHub史上最速で25万スターを突破したのだ。この数字の異常さは、比較すればわかる。かつてのスター成長速度記録を持っていたプロジェクトの数倍のペースだ。 OpenClawの基本コンセプトはシンプルだ。LLM(大規模言語モデル)を頭脳として、メッセージングプラットフォームをインターフェースに使い、ファイル操作、メール送信、API呼び出し、ワークフロー自動化といったタスクを自律的に実行する。SlackやDiscordで「今月の売上レポートをまとめてメールで送って」と指示すれば、データの収集からレポート作成、メール送信まで一気通貫でこなす——というのが理想だ。 特に中国での反響は異常だった。深圳のTencent本社前に約1,000人が行列を作ったという報道は、AIツールに対する期待がどれほど大きいかを物語っている。ただし、この行列の実態はOpenClawそのものへの関心というより、自律型AIエージェントという概念への期待の表れだったと見るべきだろう。 私はこの熱狂の渦中で、実際にOpenClawを数週間使い込んでみた。結論から言えば、このツールは確かに革命的な可能性を秘めているが、現時点では「技術デモとしては素晴らしいが、業務ツールとしては未成熟」というのが正直な評価だ。

“OpenClawはオープンソースAIエージェントの概念を大衆に届けた最初のプロジェクトだ。技術的な完成度よりも、そのビジョンが世界中の開発者を動かした”

— X @techcrunch_asia

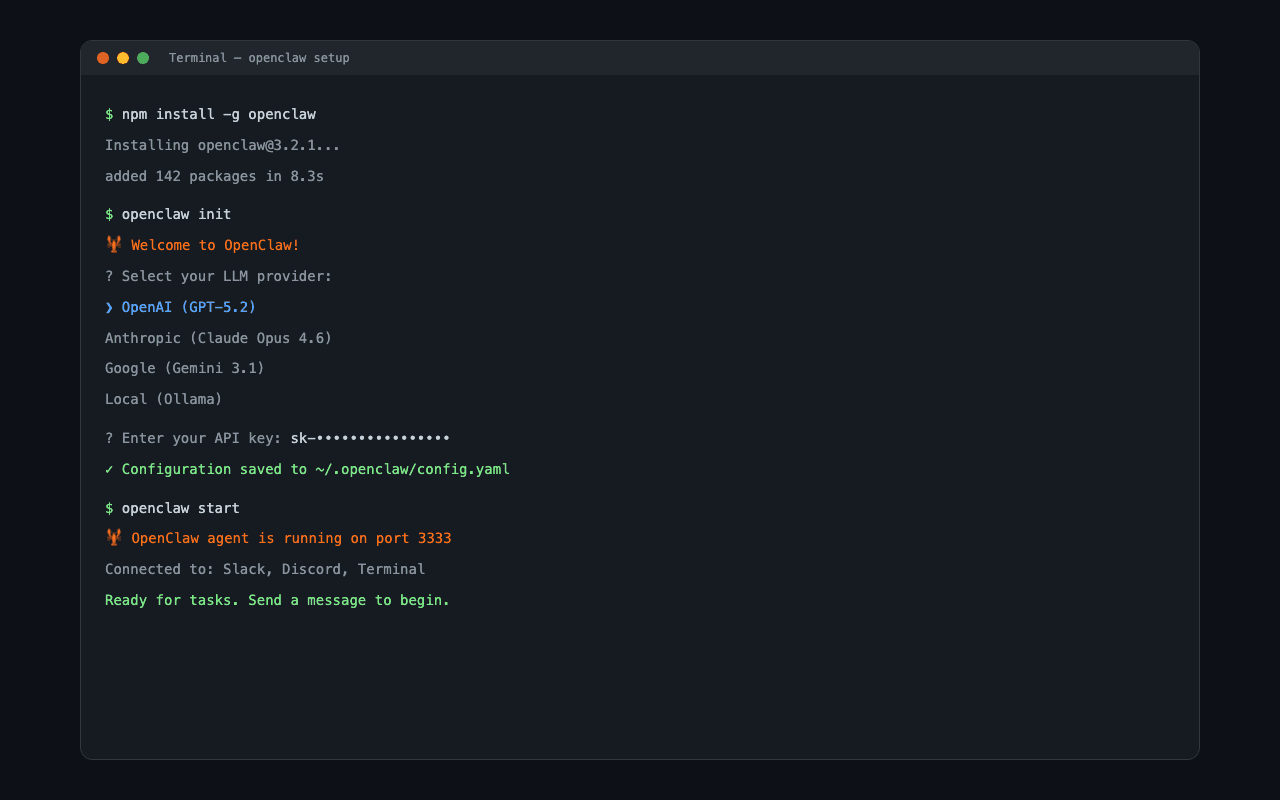

セットアップ地獄:「誰でも使える」はずが3時間格闘した話

OpenClawの最大の問題は、最初の一歩にある。GitHubのREADMEには「5分で開始」と書かれているが、これは明らかに誇張だ。私の環境(macOS Sonoma、M3 MacBook Pro)でセットアップに要した時間は約3時間だった。 まず、Node.js 20以上、Python 3.11以上、Dockerの環境が前提条件として必要になる。これだけで非エンジニアの大半は脱落するだろう。次にLLMプロバイダーのAPIキーを設定する必要がある。OpenAI、Anthropic、Google——どのモデルを使うかの選択肢があること自体は利点だが、各プロバイダーでのAPI登録、クレジットカード設定、キーの発行と設定が個別に必要だ。 設定ファイルはYAML形式で、30項目以上のパラメータがある。どのモデルをどのタスクに割り当てるか、メモリの制限をどうするか、ツール呼び出しの許可範囲をどこまで広げるか——一つ一つの設定が最終的なパフォーマンスに影響する。公式ドキュメントには推奨設定が載っているが、実環境ではそのまま使えないケースが多い。 メッセージングプラットフォームとの連携も一筋縄ではいかない。Slackとの連携にはBotトークンの発行とOAuth設定が必要で、企業のSlackワークスペースでは管理者の承認が別途必要になる。Discordの場合はBot作成からサーバーへの招待まで、10ステップ以上の手順を踏む。 コミュニティのDiscordサーバーでは「セットアップで詰まった」という投稿が毎日数十件上がっている。これは致命的な問題だ。どれだけ優れたツールでも、使い始めるまでに挫折させてしまっては意味がない。

WARNING

OpenClawの「5分セットアップ」は開発者向けの理想値。実環境では2〜3時間の初期設定を見込むべき。Docker、Node.js、Pythonの事前準備も必須。

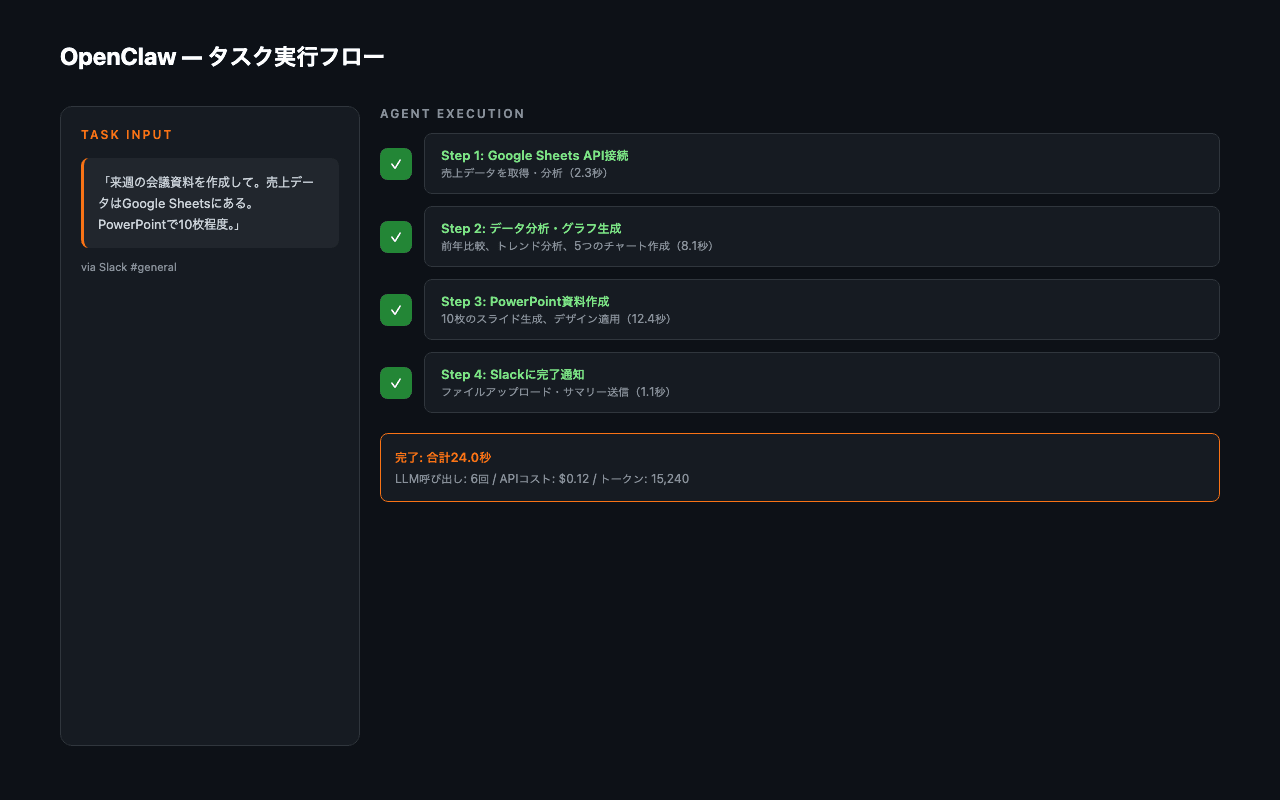

実力検証:日常業務を3週間任せて見えたこと

セットアップを乗り越えた先にあるOpenClawの実力は、正直に言って「驚き」と「落胆」が半々だった。 まず驚いた点。毎朝のルーティンとして、GitHubのIssue確認、Slackの未読メッセージ要約、当日のカレンダー確認をOpenClawに任せたところ、3日目から安定して動作するようになった。「今日の予定と未対応のIssueを優先度順にまとめて」という指示一つで、複数のAPIを横断してレポートを生成する。この体験は確かに未来的だった。 ファイル操作系のタスクも得意だ。「先月のCSVデータを集計して、売上トップ10の一覧をMarkdownで作成して」という指示に対し、正確にファイルを読み込み、pandas相当の処理を実行し、整形されたMarkdownファイルを出力した。単純なデータ処理タスクでは、人間が手作業でやるよりも確実に速い。 一方で落胆した点。複雑なマルチステップタスクでは頻繁に失敗する。「Webサイトのスクレイピングをして、データをDBに保存し、変更があればメールで通知する」という3段階のタスクでは、2段階目で型エラーが発生し、そこからリカバリーできずに無限ループに陥った。APIコストが無駄に消費される上に、結局人間が介入して手動で修正する羽目になった。 また、日本語での指示に対する精度は英語と比べて明らかに劣る。これはOpenClaw自体の問題というより、背後のLLMの言語性能に依存する部分だが、日本のユーザーにとっては重要な点だ。Claude 3.5 Sonnetを使用した場合は比較的マシだが、GPT-4oでは日本語の指示が意図通りに解釈されないケースが散見された。

“OpenClawは90%のタスクを10分で終わらせる。残り10%の複雑なタスクに10時間かかる。その10時間で自分でやった方が早い”

— Hacker News コメント

APIコストの罠:「無料」の看板に隠れた月額の真実

OpenClawはオープンソースで無料だ。これは事実だ。しかし「無料で使える」かと問われれば、答えはNoだ。 自律型エージェントの本質的な問題は、タスク実行のたびにLLMへのAPI呼び出しが発生することにある。単純な質問応答なら1回のAPI呼び出しで済むが、OpenClawのようなエージェントは1つのタスクで5〜30回のAPI呼び出しを行う。ファイルを読む、計画を立てる、コードを生成する、実行する、結果を確認する——各ステップでLLMが呼び出される。 3週間の検証期間中、私が支払ったAPI費用を正直に公開する。OpenAI GPT-4oをメインモデルとして使用した場合、1日あたり平均3〜5ドル。月換算で90〜150ドル(約13,500〜22,500円)になる。Claude 3.5 Sonnetに切り替えた場合はやや安く、1日2〜4ドル程度だったが、それでも月60〜120ドル(約9,000〜18,000円)は覚悟が必要だ。 ローカルLLM(Ollama経由でLlama 3を使用)を試したが、レスポンス速度が実用レベルに達しておらず、複雑なタスクでは指示を正しく理解できない場面が多かった。コスト削減のためにローカルモデルを使うという選択肢は、現時点では現実的ではない。 結局のところ、OpenClawの「無料」はソフトウェア本体に対する価格であって、運用コストは別だ。Manus AIのように月額固定で使えるサービスと比較すると、コストの予測可能性で大きく劣る。

LLMプロバイダー別 月間運用コスト目安(1日10タスク実行時)

| LLMプロバイダー | 月間API費用(目安) | 応答速度 | 日本語精度 | 推奨用途 |

|---|---|---|---|---|

| OpenAI GPT-4o | 90〜150ドル | 速い | △ | 英語中心の複雑タスク |

| Anthropic Claude 3.5 Sonnet | 60〜120ドル | 普通 | ○ | 日本語タスク全般 |

| Google Gemini Pro | 40〜80ドル | 速い | △ | コスト重視の軽量タスク |

| ローカルLLM(Llama 3等) | 電気代のみ | 非常に遅い | × | 実験・学習目的のみ |

POINT

OpenClaw本体は無料だが、LLMのAPI費用は月額60〜150ドルが現実的な運用コスト。タスクの複雑さとAPI呼び出し回数に直結するため、使い方次第で大きく変動する。

中国の熱狂と政府規制:OpenClawが映し出すAIエージェントのジレンマ

OpenClawの物語を語る上で、中国での現象は避けて通れない。Tencent本社前に約1,000人が行列を作ったという出来事は、単なるバズではなく、自律型AIエージェントという技術カテゴリに対する社会的期待の大きさを示していた。 しかし、この熱狂の直後に中国政府は国家機関でのOpenClaw使用を制限する通達を出した。理由はセキュリティ上の懸念だ。OpenClawのようなエージェントは、メール送信、ファイル操作、API呼び出しといった実世界への作用を伴う。万が一、悪意あるプロンプトインジェクションや設定ミスで意図しない動作が発生した場合、被害は情報漏洩にとどまらない。 この懸念は中国に限った話ではない。日本の企業でも、自律型エージェントの導入には慎重な姿勢が目立つ。筆者が取材した大手SIerの技術部長は「PoC(概念実証)としては興味深いが、本番環境に投入するにはガバナンスの枠組みが追いついていない」と語った。 実際、OpenClawにはサンドボックス機能やアクセス制御の仕組みが実装されているが、デフォルト設定では広範なシステム権限を要求する。ファイルシステムへの読み書き、ネットワーク通信、外部API呼び出し——これらの権限を適切に制限しないまま運用すれば、意図しないデータ流出やシステム破壊のリスクがある。 オープンソースであることは透明性という点では利点だが、セキュリティ監査が追いついていないという懸念もある。コミュニティ主導の開発体制では、脆弱性の発見から修正までのタイムラインが不確定だ。Peter SteinbergerがOpenAIに移籍して以降、プロジェクトの方向性についてもコミュニティ内で議論が続いている。

競合比較:Manus AI、Claude Codeエージェント、AutoGPTとの違い

自律型AIエージェントの分野は2026年に入って急速に競争が激化している。OpenClawの直接的な競合を使い比べた。 Manus AIは最も洗練された商用エージェントだ。月額制のSaaS型で、ブラウザ上で完結する。セットアップの手間はほぼゼロで、非エンジニアでも使い始められる。タスクの安定性もOpenClawより明らかに高い。ただし月額199ドルという価格は個人には重い上、カスタマイズ性はOpenClawに遠く及ばない。 Claude Codeのエージェント機能は、コーディングタスクに特化している点でOpenClawとは用途が異なる。ただし「コードを書く→テストする→デプロイする」という一連のフローを自律的に実行する点ではエージェント的だ。AnthropicがClaude Codeで培ったエージェント技術は、将来的にOpenClawの直接的な競合になる可能性が高い。 AutoGPTは思想的にOpenClawの先駆者だが、開発の停滞感がある。2024年にバズった後、コミュニティの関心はOpenClawに移った。技術的にはOpenClawの方が洗練されており、ツール連携の豊富さとメッセージングプラットフォーム対応で差がある。 結論として、「カスタマイズ性と自由度を求めるならOpenClaw」「安定性と手軽さを求めるならManus AI」「コーディング特化ならClaude Code」という棲み分けが現時点では妥当だ。ただし、AnthropicとOpenAIが独自のエージェント製品を投入すれば、この構図は一気に変わる可能性がある。

自律型AIエージェント主要ツール比較

| 項目 | OpenClaw | Manus AI | Claude Code agents | AutoGPT |

|---|---|---|---|---|

| 価格 | 無料(API費用別) | 月額199ドル | Proプラン内 | 無料(API費用別) |

| セットアップ難易度 | 高い | 極めて低い | 低い | 高い |

| タスク安定性 | 中程度 | 高い | 高い(コード特化) | 低い |

| カスタマイズ性 | 非常に高い | 低い | 中程度 | 高い |

| 日本語対応 | LLM依存 | ○ | ○ | LLM依存 |

| メッセージング連携 | Slack/Discord/他 | Web UIのみ | CLI | 限定的 |

| コミュニティ規模 | 非常に大きい | 小さい | 大きい | 縮小傾向 |

数週間使った正直な評価:革命の種か、それとも過大評価か

OpenClawを数週間使い込んだ結論を述べる。このツールは確かに「自律型AIエージェント」という概念を世に知らしめた歴史的なプロジェクトだ。25万スターの数字は伊達ではなく、コミュニティの活力は本物だ。定型的なタスク自動化、マルチAPI連携、ワークフローの構築において、個人開発者が手の届く範囲で最も強力なツールの一つであることは間違いない。 しかし、現時点のOpenClawを「業務で使えるか」と問われれば、条件付きでYesだ。その条件とは——セットアップに3時間かける覚悟があり、月額60〜150ドルのAPI費用を許容でき、複雑なタスクが失敗した際に自分でデバッグする技術力があること。これらを満たせない場合、素直にManus AIのような商用サービスを使った方が生産的だ。 最も懸念しているのはセキュリティだ。中国政府の規制は過剰反応ではなく、自律型エージェントがシステム権限を持って動作するリスクを正当に指摘している。OpenClawのコミュニティはこの問題に取り組んでいるが、Peter Steinbergerの離脱後、セキュリティ面のリードが不在という声もある。 それでも、OpenClawが示した可能性——メッセージ一つで複雑なタスクが完了する未来——には確かなリアリティがある。AnthropicとOpenAIが競争的にエージェント製品を開発している事実が、この方向性の正しさを裏付けている。OpenClawは完成品ではなく、来るべきエージェント時代の「プレビュー版」だ。興味のある技術者は今のうちに触っておくべきだが、過度な期待は禁物である。

“OpenClawは未来の働き方を垣間見せてくれた。ただし、その未来にはまだ2〜3年のバグ修正が必要だ”

— Reddit r/artificial

Good

- +完全無料のオープンソースで、ベンダーロックインのリスクがない

- +あらゆるLLMプロバイダーと連携可能で、モデル選択の自由度が極めて高い

- +Slack・Discord等のメッセージングプラットフォーム経由で自然に操作できる

- +コミュニティが非常に活発で、プラグインやツール連携が急速に拡充している

- +定型的なワークフロー自動化における生産性向上効果が顕著

Bad

- −セットアップが複雑で、非エンジニアには事実上使用不可能

- −LLMのAPIコストが月額60〜150ドル程度かかり「無料」とは言い難い

- −複雑なマルチステップタスクで頻繁に失敗し、無限ループに陥ることがある

- −中国政府の使用制限に象徴されるセキュリティリスクの懸念

- −Peter Steinberger離脱後のプロジェクトガバナンスが不安定

- −日本語での指示精度が英語と比べて明らかに劣る(LLM依存)

結論

OpenClawは2026年初頭を代表するテック現象であり、自律型AIエージェントという概念を世界規模で認知させた功績は大きい。GitHub史上最速の25万スター、中国でのバイラル、各国政府の反応——これらすべてが、AIエージェントが次のパラダイムであることを裏付けている。 実際の使用感は、熱狂から一歩引いて見れば「有望だが未成熟」の一言に尽きる。定型タスクの自動化、マルチAPI連携、メッセージングプラットフォーム経由の操作体験は確かに未来的だ。しかし、セットアップの複雑さ、APIコストの不透明さ、複雑なタスクでの不安定さ、セキュリティ上の懸念——これらの課題は現時点では解消されていない。 Peter SteinbergerがOpenAIに移籍した後、プロジェクトはコミュニティ主導に移行した。これがプラスに転じるかマイナスに転じるかは、今後のガバナンス体制次第だ。AnthropicとOpenAIがそれぞれ競合するエージェント製品を開発中であることを考えると、OpenClawがオープンソースの旗手として独自のポジションを維持できるかが鍵になる。 技術者であれば、今のうちに触っておく価値は間違いなくある。自律型エージェントの設計思想、プロンプトエンジニアリングの実践、マルチツール連携のアーキテクチャ——学べることは多い。ただし「これで仕事が全部自動化できる」という期待は、現時点では明確に過大評価だ。OpenClawは完成品ではなく、来るべきエージェント時代への招待状である。

こんな人におすすめ

- →自律型AIエージェントの設計と実装を学びたいエンジニア

- →定型業務の自動化で生産性を上げたい個人開発者・フリーランス

- →オープンソースのカスタマイズ性を活かして独自ワークフローを構築したい技術者

- →LLMのAPI活用やプロンプトエンジニアリングの実践経験を積みたい人

- →商用エージェントサービスのコストを避けつつ自動化を実現したいスタートアップ

Tool Info